阿里巴巴周一发布了通义千问3.0(Qwen3)系列模型并将其开源。称该模型在数学和编程等多方面性能能与DeepSeek相媲美。和其他主流模型相比,Qwen3显著降低了部署成本。阿里表示,Qwen3无缝集成两种思考模式。它支持119种语言。便于Agent调用。

并且全部实现开源

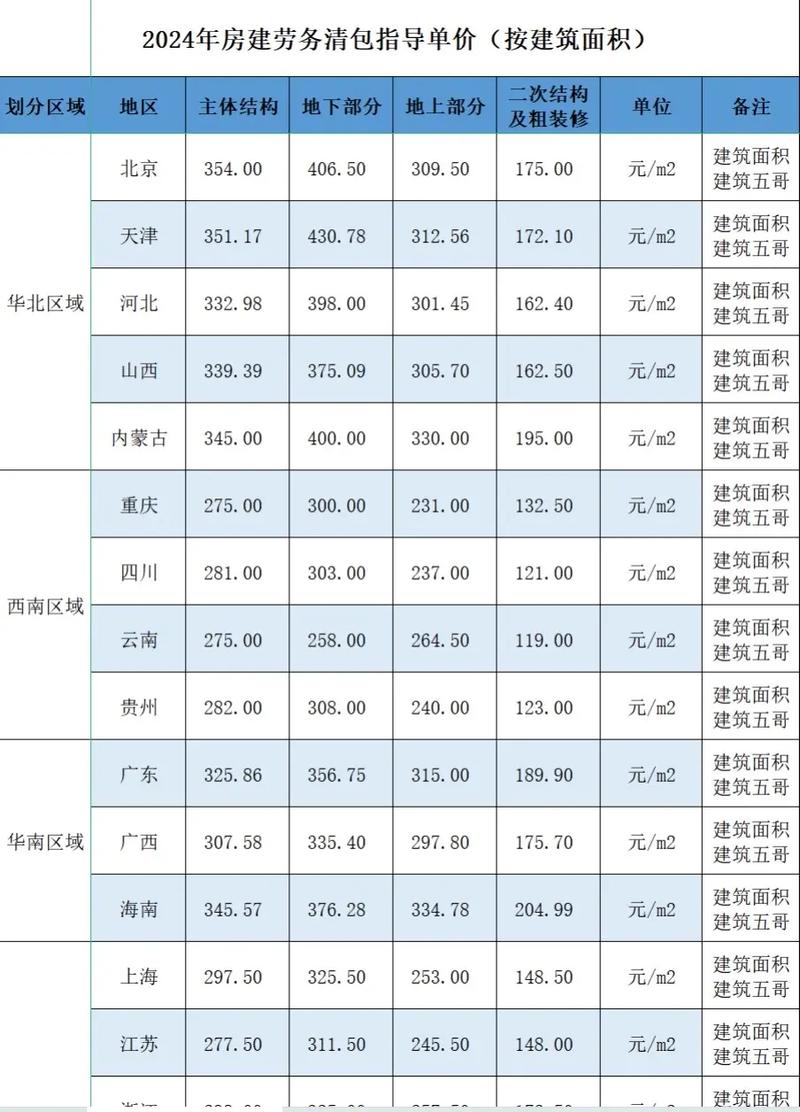

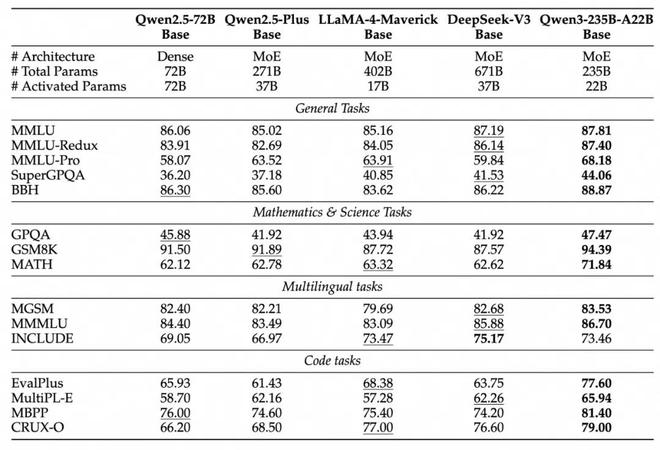

Qwen3系列包含两个专家混合(MoE)模型以及另外六个模型。阿里巴巴称,最新发布的旗舰模型Qwen3-235B-A22B,在代码基准测试中,与DeepSeek-R1、o1、o3-mini、Grok-3和Gemini-2.5-Pro等顶级模型相比,表现极具竞争力。在数学基准测试中,该模型同样与这些顶级模型相比,表现极具竞争力。在通用能力基准测试中,此模型还是与这些顶级模型相比,表现极具竞争力。

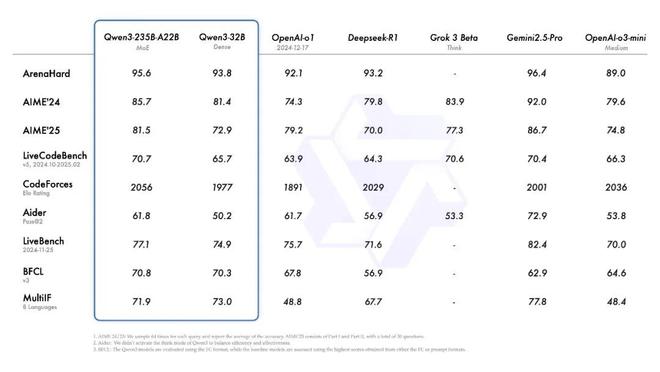

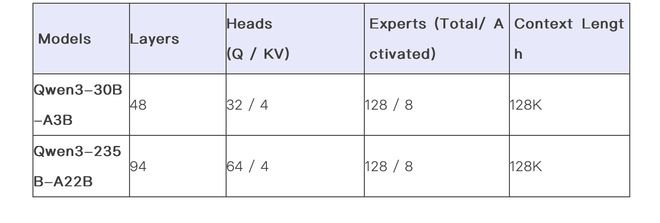

此外,有一种被称作“专家混合”(MoE,Mixture-of-Experts)模型的Qwen3-30B-A3B。它的激活参数数量是QwQ-32B的10%。其表现更为出色。甚至像Qwen3-4B这样的小模型。也能够与Qwen2.5-72B-Instruct的性能相匹敌。这类系统模拟人类解决问题的思维方式。它把任务划分为更小的数据集。这类似于让一组各有所长的专家。分别负责不同部分。进而提升整体效率。

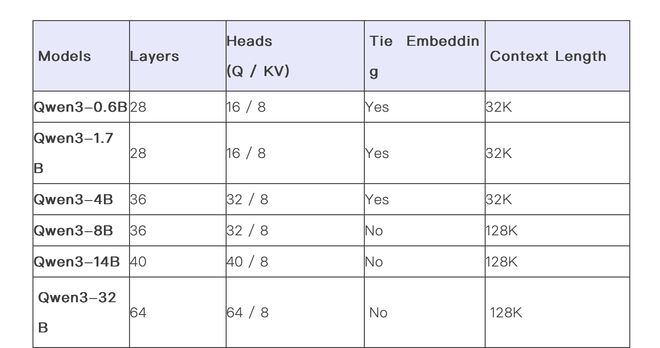

与此同时 阿里巴巴开源了两个MoE模型的权重 一个是Qwen3-235B-A22B 它有2350多亿总参数和220多亿激活参数 另一个是小型MoE模型Qwen3-30B-A3B 它有约300亿总参数和30亿激活参数此外 六个Dense模型已开源 它们是Qwen3-32B Qwen3-14B Qwen3-8B Qwen3-4B Qwen3-1.7B和Qwen3-0.6B 这些模型都在Apache 2.0许可下开源

“混合型”模型,两种思考模式

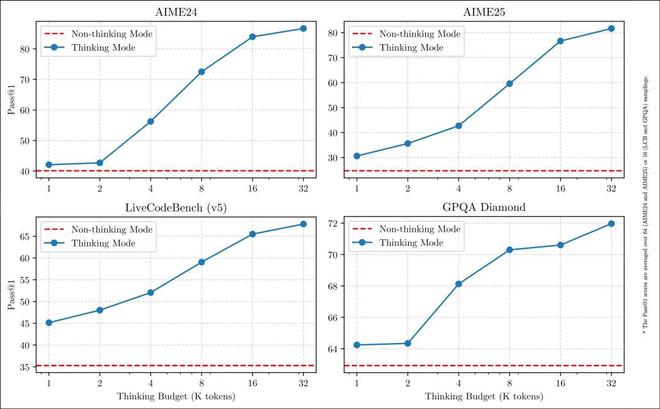

阿里巴巴称,Qwen 3系列属于“混合型”模型。它能花时间“推理”来解决复杂问题。也能快速回应简单请求。这两种模式分别称作“思考模式”和“非思考模式”。“思考模式”里的推理能力让模型可有效自我事实核查。类似OpenAI的o3模型。不过代价是推理时延迟时间较长。

Qwen团队在博客文章中写道:

这种灵活性让用户能依照具体任务控制模型“思考”的程度。比如,复杂问题可借由扩展推理步骤解决。简单问题则能直接快速作答,无需耽搁。

至关重要的是,这两种模式相结合,极大增强了模型控制“思考预算”的能力,使其稳定且高效。如上文所述,Qwen3性能提升可扩展且平滑,这和分配的计算推理预算直接相关。

这样的设计能让用户更轻松地为不同任务配置特定预算。它可在成本效益和推理质量之间实现更优平衡。

训练数据量是Qwen2.5的两倍,便于Agent调用

阿里巴巴表明,Qwen3系列能支持119种语言。它基于近36万亿个token训练。其使用的数据量是Qwen2.5的两倍。Token是模型处理的基本数据单元。约100万个token相当于75万英文单词。阿里巴巴宣称,Qwen3的训练数据涵盖教材、问答对、代码片段等多种内容

据介绍,Qwen3预训练过程分三个阶段。第一阶段是S1。此阶段模型在超30万亿个token上预训练。上下文长度是4K token。该阶段为模型提供基本语言技能与通用知识。

在第二阶段即S2,训练通过加大知识密集型数据比例改进数据集,像STEM、编程和推理任务这些数据。随后模型在额外的5万亿个token上做了预训练。在最后阶段,用高质量的长上下文数据把上下文长度扩充到32K token,保证模型能有效处理更长输入

阿里巴巴称,因模型架构改进,训练数据增多,训练方法更有效,Qwen3 Dense基础模型整体性能与参数更多的Qwen2.5基础模型相当。比如,Qwen3-1.7B/4B/8B/14B/32B-base分别和Qwen2.5-3B/7B/14B/32B/72B-base表现相当特别是在STEM、编码和推理等领域。Qwen3 Dense基础模型表现出色。其表现甚至超过了更大规模的Qwen2.5模型。对于Qwen3 MoE基础模型。它们在仅使用10%激活参数时。达到了与Qwen2.5 Dense基础模型相似的性能。显著节省了训练成本。也显著节省了推理成本

在后训练阶段 阿里用多样长思维链数据微调模型 数据涵盖数学 代码 逻辑推理和STEM问题等多种任务和领域 为模型配备基本推理能力 然后通过大规模强化学习 利用基于规则的奖励增强模型探索和钻研能力

阿里巴巴称,Qwen3在调用工具方面表现出色,在执行指令方面表现出色,在复制特定数据格式等能力方面表现出色,推荐用户使用Qwen-Agent以充分发挥Qwen3的Agent能力。Qwen-Agent内部封装了工具调用模板,Qwen-Agent内部封装了工具调用解析器,这大大降低了代码复杂性。

Qwen3除了有下载版本。还能够借助Fireworks AI、Hyperbolic等云服务提供商来使用。

目标仍对准AGI

OpenAI、谷歌和Anthropic近期相继推出多款新模型。OpenAI近日宣称,打算在未来几个月发布一款更“开放”的模型,该模型模仿人类推理方式,这意味着其策略有转变,此前DeepSeek和阿里巴巴已率先推出开源AI系统。

当下,阿里巴巴正围绕Qwen构建自身的AI版图。今年2月,首席执行官吴泳铭称,公司当前的“首要目标”是达成通用人工智能,也就是打造拥有人类智力水准的AI系统。

阿里称,Qwen3是该公司迈向通用人工智能与超级人工智能进程里的一个重要里程碑。展望未来,阿里打算从多个方面提升模型。包括优化模型架构。还要优化训练方法。以此实现几个关键目标。比如扩展数据规模。增加模型大小。延长上下文长度。拓宽模态范围。并且利用环境反馈推进强化学习来进行长周期推理。

开源社区振奋

阿里发布了Qwen3,这使得AI社区激动不已,有网友献上了经典Meme

有网友说,

在我的测试里 235B在高维张量运算方面 有着和Sonnet相当的表现

这是一个非常出色的模型,

感谢你们。

有网友对Qwen3赞不绝口:

而开源AI的支持者则更加兴奋。有网友说:

有了一个开源的32B大模型。其性能与Gemini 2.5 Pro相当。

“我们彻底杀回来了!”

网友感谢阿里积极推动开源: